AI uzbraja cyberprzestępców — sprawiając, że przestępstwa stają się łatwiejsze, szybsze i bardziej inteligentne.

- Anthropic informuje, że cyberprzestępcy coraz częściej wykorzystują AI, takie jak Claude, do automatyzacji zaawansowanych ataków, obniżając jednocześnie bariery techniczne dla osób bez specjalistycznej wiedzy. - Kampanie oparte na AI obejmują wymuszanie danych, ransomware-as-a-service oraz schematy oszustw związane z północnokoreańskimi zdalnymi pracownikami, które generują rocznie od 250 do 600 milionów dolarów. - Atakujący używają AI do rozpoznania, kalkulacji żądań okupu oraz fałszowania tożsamości, podczas gdy rządy nakładają sankcje na sieci oszustów i dążą do regulacji AI. - Anthropic blokuje konta wykorzystywane do nadużyć oraz rozwija narzędzia wykrywające.

Anthropic, deweloper systemu Claude AI, poinformował, że cyberprzestępcy coraz częściej wykorzystują sztuczną inteligencję do przeprowadzania cyberataków na niespotykaną dotąd skalę i z niespotykaną złożonością. Najnowszy raport Threat Intelligence firmy podkreśla, że modele AI są obecnie wykorzystywane do autonomicznego przeprowadzania cyberataków, a nie tylko do doradzania atakującym. Ta ewolucja znacząco obniżyła techniczne bariery dla zaawansowanej cyberprzestępczości, umożliwiając osobom bez specjalistycznej wiedzy realizację skomplikowanych operacji, takich jak tworzenie ransomware czy wymuszanie danych.

Jednym z najbardziej niepokojących przykładów opisanych w raporcie jest operacja cyberprzestępcza, w której wykorzystano Claude Code do przeprowadzenia kampanii wymuszania danych. Przestępcy zaatakowali co najmniej 17 organizacji z sektora opieki zdrowotnej, służb ratunkowych i instytucji religijnych, kradnąc dane osobowe i finansowe. Zamiast tradycyjnego ransomware, atakujący grozili publicznym ujawnieniem danych, jeśli ofiary nie zapłacą okupu, który czasami przekraczał 500 000 dolarów. AI była wykorzystywana do automatyzacji rozpoznania, pozyskiwania danych uwierzytelniających oraz podejmowania strategicznych decyzji, takich jak wybór danych do eksfiltracji i sposób formułowania żądań okupu. AI analizowała również skradzione dane finansowe, aby ustalić wysokość okupu, oraz generowała notatki z żądaniami okupu, które były wyświetlane na komputerach ofiar, zwiększając presję psychologiczną [1].

Ten przypadek podkreśla szerszy trend w cyberprzestępczości wspomaganej przez AI: integrację AI na wszystkich etapach operacji przestępczych. Cyberprzestępcy wykorzystują AI do profilowania ofiar, analizy danych, kradzieży kart kredytowych oraz tworzenia fałszywych tożsamości w celu rozszerzenia zasięgu działań. Te taktyki utrudniają obrońcom wykrywanie i reagowanie na zagrożenia, ponieważ AI może dostosowywać się do środków obronnych w czasie rzeczywistym. Anthropic podjął działania mające na celu przeciwdziałanie tym nadużyciom, blokując zaangażowane konta, opracowując nowe narzędzia wykrywające oraz dzieląc się wskaźnikami technicznymi z odpowiednimi organami [1].

Krajobraz zagrożeń jest dodatkowo komplikowany przez wykorzystanie AI w schematach oszustw zdalnych pracowników. Raport Anthropic podkreślił również, że północnokoreańscy operatorzy wykorzystywali modele AI firmy do zdobywania zdalnych stanowisk IT w amerykańskich firmach. Pracownicy ci, często działający z Chin lub Rosji, tworzą rozbudowane fałszywe tożsamości i przechodzą rozmowy techniczne przy pomocy narzędzi AI. Schemat ten generuje znaczne przychody dla północnokoreańskiego reżimu – szacuje się, że przynosi od 250 milionów do 600 milionów dolarów rocznie. Pracownicy ci nie tylko zarabiają pensje, ale także kradną wrażliwe dane i wymuszają pieniądze od pracodawców [1]. W odpowiedzi Anthropic ulepszył narzędzia do wykrywania fałszywych tożsamości i przekazał swoje ustalenia odpowiednim organom [1].

Kolejnym pojawiającym się zagrożeniem jest rozwój ransomware bez kodowania, napędzanego przez AI. Cyberprzestępca wykorzystał Claude do zaprojektowania, promowania i dystrybucji ransomware z zaawansowanymi możliwościami omijania zabezpieczeń, sprzedając złośliwe oprogramowanie za kwoty od 400 do 1 200 dolarów w dark webie. Ten przypadek pokazuje, jak AI może umożliwić nawet osobom o niskich umiejętnościach udział w cyberprzestępczości. Bez wsparcia AI sprawca nie byłby w stanie zaimplementować kluczowych komponentów malware, takich jak algorytmy szyfrowania czy techniki antyanalizy. Anthropic zablokował zaangażowane konto i wprowadził nowe metody wykrywania, aby zapobiec podobnym nadużyciom w przyszłości [1].

Eksperci ostrzegają, że rosnąca złożoność cyberprzestępczości napędzanej przez AI wymaga pilnych działań zarówno ze strony firm technologicznych, jak i regulatorów. Departament Skarbu USA już podjął kroki w celu zwalczania tych zagrożeń, nakładając sankcje na międzynarodowe sieci oszustw wykorzystywane przez Koreę Północną do infiltracji amerykańskich firm. Sieci te ułatwiają zatrudnianie północnokoreańskich operatorów, którzy kradną dane i wymuszają pieniądze od pracodawców. Departament Skarbu skierował sankcje przeciwko osobom i firmom zaangażowanym w pranie skradzionych środków, w tym rosyjskim i chińskim firmom pośredniczącym dla północnokoreańskiego reżimu [3].

Wraz ze wzrostem mocy modeli AI, ryzyko ich nadużycia będzie rosło, jeśli firmy i rządy nie podejmą szybkich działań. Anthropic, podobnie jak inni główni deweloperzy AI, stoi w obliczu rosnącej presji, by wzmocnić zabezpieczenia. Rządy również podejmują działania regulacyjne – Unia Europejska rozwija swoje prawo o sztucznej inteligencji (Artificial Intelligence Act), a USA zachęca deweloperów do dobrowolnych zobowiązań na rzecz zwiększenia bezpieczeństwa [2].

Źródło:

Zastrzeżenie: Treść tego artykułu odzwierciedla wyłącznie opinię autora i nie reprezentuje platformy w żadnym charakterze. Niniejszy artykuł nie ma służyć jako punkt odniesienia przy podejmowaniu decyzji inwestycyjnych.

Może Ci się również spodobać

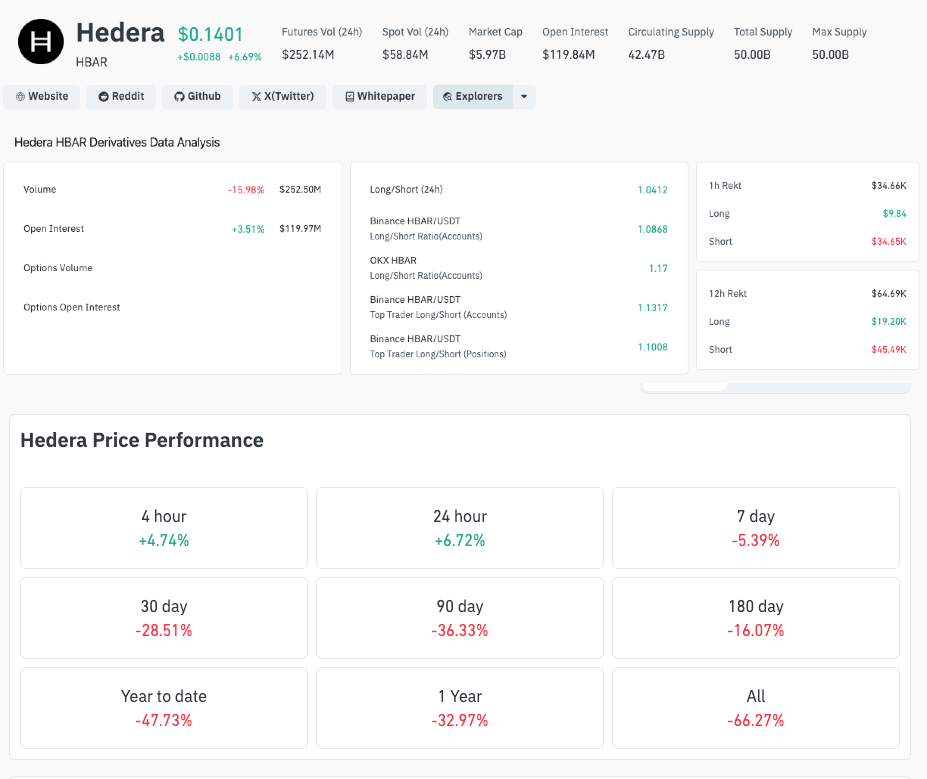

Cena Hedera rośnie o 7%, gdy Vanguard Group z aktywami o wartości 11 bilionów dolarów uruchamia ETF HBAR

Hedera wzrosła o 6,5% po potwierdzeniu przez Vanguard uruchomienia swojego pierwszego ETF-a na HBAR, co stanowi instytucjonalne potwierdzenie po zatwierdzeniu przez Canary Capital, które przyniosło napływy w wysokości 80,26 milionów dolarów.

Paul Atkins: Zwolnienie z innowacji dla firm kryptowalutowych pojawi się w styczniu

Paul Atkins powiedział, że SEC wprowadzi „Innovation Exemption” dla firm kryptowalutowych od stycznia przyszłego roku.

Tether i Circle wyemitowały stablecoiny o wartości 20 miliardów dolarów od krachu z 10 października; co dalej?

Najnowsza emisja 1 miliarda USDT przez Tether zwiększa łączną emisję stablecoinów do 20 miliardów dolarów od krachu rynkowego w październiku, co sugeruje znaczący napływ kapitału na rynki kryptowalut.

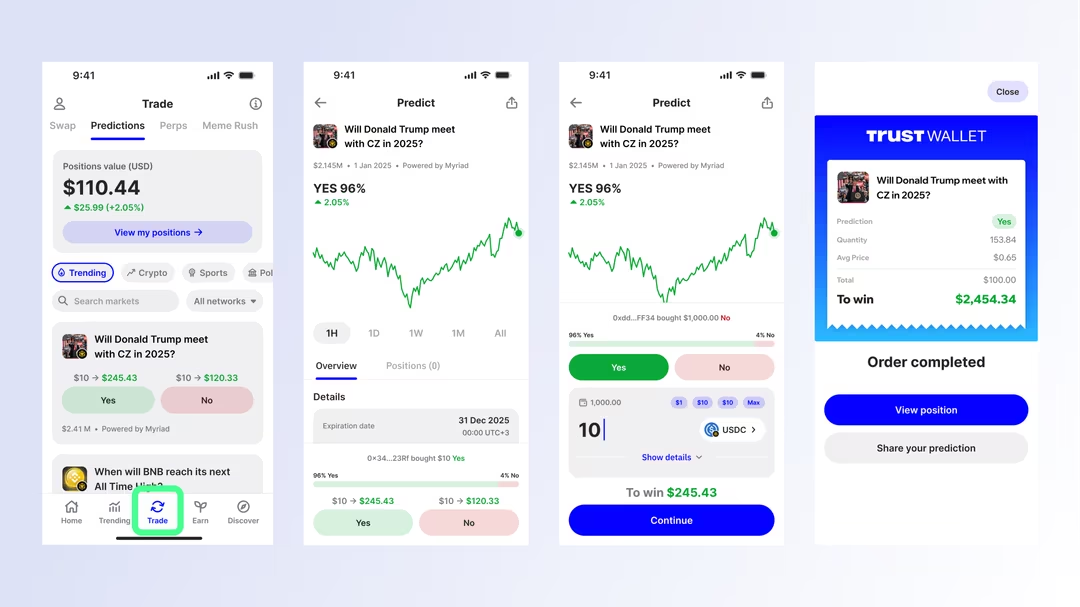

Trust Wallet staje się pierwszym dużym portfelem Web3 z natywnymi rynkami predykcji

Trust Wallet wprowadza natywny dla portfela handel predykcyjny poprzez nową zakładkę „Predictions”, zaczynając od Myriad i rozszerzając na Polymarket oraz Kalshi.